万卡集群技术破局:国内首批智算中心的架构设计与工程实践

2021年夏天,当我第一次踏进松江智算中心所在的园区,迎接我的只有空荡荡的厂房和几台待安装的服务器框架。三年后的今天,这里运行着上万张GPU芯片,每秒执行万亿次运算,两天的算力产出便相当于三峡水电站一台机组一小时的发电量。作为这场建设浪潮的亲历者,我想用技术视角复盘这背后的一切。

从零起步:万卡集群为何难建

万卡集群的搭建难度远超外界想象。芯片紧缺只是表象,真正的挑战在于几十万个零部件的精确协同——服务器、光模块、高速网线、存储设备,任何一环出现毫厘偏差,整套系统都可能陷入宕机。更棘手的是,AI算力芯片的故障率远高于传统IT设备,大规模集群的稳定性维护本身就是一个系统工程难题。

2023年大模型浪潮席卷全球时,国内具备万卡集群搭建经验的核心人才不足千人。摆在初创团队面前的是一片技术荒原:无成熟案例可循,团队多数成员甚至从未接触过GPU实操。

并行突破:攻坚阶段的技术抉择

面对紧迫的时间窗口,团队采取了一种非传统的建设模式——并行施工与边测边调同步推进。传统线性流程被彻底打破,建设的同时启动调试优化,压缩了整个交付周期。

为追求0.1%的性能提升,工程师们可以连续数周熬夜调试参数。在AI行业,迭代周期以周甚至天计算,1%的领先经过日积月累便可能转化为代际优势。仪电智算中心距离市区单程两三个小时,为节省通勤时间,不少工程师选择在机房过夜,一待就是一两个月。

稳定性难题:多元异构下的调度革命

集群建成后,真正的考验才刚刚开始。大模型训练过程中,哪怕仅1分钟的算力中断,都可能造成几十个小时的训练结果损失。翟雨佳打过一个形象的比喻:万卡集群如同上万架无人机在空中高速穿梭,每张芯片都容不下一毫米的误差。

更大的挑战来自“多元异构”。万卡集群对GPU需求巨大,单一厂商根本无法供货,必须兼容各类厂商、各代际的GPU。每增加一种芯片,排列组合数便呈指数级增长,工程师需要在几十万个参数中寻找最优解。

自研破局:动态感知调度方案

智算科技选择了一条艰难的技术路线:不依赖任何厂商的“全家桶”方案,自主打通底层技术栈。在实战中,团队摸索出了“动态感知调度方案”,通过自研调度算法实现三项核心能力:实时检测、即时干预、主动预防。

这套方案的实际效果超出预期:大模型训练效率提升90%以上。这意味着AI企业能够节省大量时间和资金成本,而芯片的价值也得到了更充分的释放。

工程方法论的沉淀

回顾整个建设过程,有几条方法论值得沉淀。首先是“快速试错”机制,AI行业窗口期极短,必须在行动中迭代而非追求完美方案。其次是“全栈穿透”思维,从芯片到应用的每一层都必须理解透彻,任何单点依赖都可能成为瓶颈。最后是“故障前置化”理念,将被动响应转变为主动预防,把问题消灭在萌芽阶段。

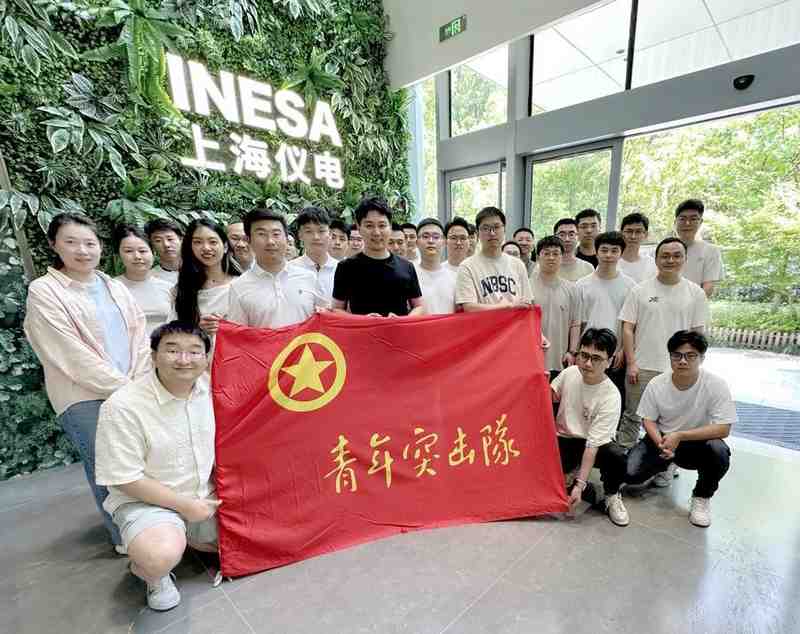

这支平均年龄32岁的团队,用两年时间完成了从零基础到国内首批万卡集群的跨越。在AI算力这个全新赛道上,工程能力才是决定胜负的关键变量。